December végén, mindössze kilenc nap leforgása alatt, az xAI Grok eszközét nők millióiról készült, beleegyezés nélküli intim képek generálására és közzétételére használták. Az olyan kéréseket, amelyek a nők képeit zúzódásokkal, vérrel vagy akár golyó ütötte nyomokkal módosították volna, azonnal teljesítette a platform.

A rasszizmus mélyen összefonódott a nőgyűlölettel

Alexandria Ocasio-Cortez demokrata kongresszusi képviselőnőt, Zendayát, Cardi B-t és más prominens politikusokat, illetve hírességeket olyan AI promptokkal vettek célba, amelyek fehér bőrrel ábrázolták volna őket. Egy zsidó nő azt tapasztalta, hogy olyan mesterséges intelligencia által generált kép készült róla, amelyen bikiniben áll Auschwitz előtt. A képek milliói tartalmaztak gyermekek elleni szexuális visszaélést is.

Alig néhány héttel később a Waymo bejelentette, hogy 2026 végéig Londonban is bevezeti önvezető autóit. Ezeket a járműveket évek óta fejlesztik, de még bizonyítaniuk kell, hogy megfelelnek a szigorú biztonsági előírásoknak – beleértve a hackelés vagy kibertámadások elleni védelmet –, mielőtt felengednék őket a brit utakra. Ezzel szemben az AI-eszközök, amelyek lehetővé teszik a nők zaklatását, megalázását, bántalmazását és könyörtelen üldözését, láthatóan nem igényelnek ilyen védőkorlátokat.

A szabályozás mint „ellenség”

Az elmúlt két évtizedben a Big Tech lobbi – amelyet a pénz és a hatalmi pozíciókban lévők példátlan közelsége olajozott – elsöprő sikert aratott abban, hogy meggyőzzön minket: a szektor szabályozása szinte lehetetlen feladat. Érvelésük szerint a szabályozás az innováció halálos ellensége: megfojtja a kreativitást, megakasztja a fejlődést, sőt, akár az egész iparágat elsöpörheti.

„A kormányzati szabályozás túlzott kiterjesztése súlyos fenyegetést jelenthet a kialakulóban lévő, ígéretes technológiákra. Ez különösen igaz az AI esetében” – olvasható az International Bankerben tavaly szeptemberben megjelent cikkben, nagyjából ugyanakkor, amikor az AI-adatcsipeket gyártó Nvidia piaci tőkeértéke elérte a rekordnak számító 5 billió (5000 milliárd) dollárt, és a világ legértékesebb vállalatává vált.

A beleegyezés nélküli deepfake (hamisított, AI által generált) pornográfia és az alkalmazások által segített szexuális visszaélések robbanásszerű terjedése csupán egyik aspektusa annak a technológiai forradalomnak, amely átalakítja a nők életét. Kevésbé publikált – bár nem kevésbé elterjedt – az a mód, ahogyan az egyenlőtlenség és a diszkrimináció meglévő formáit az elfogult vagy félrevezető adatokon tanított eszközök megismétlik és felerősítik. A szextől az egészségügyig, az oktatástól a büntetőügyekig az új technológiák a nemi alapú hatalom és visszaélés ősi mintázatainak felerősítését teszik lehetővé.

A reprezentáció hiánya

Az AI-kutatóknak mindössze 12%-a nő, a női alapítók pedig a kockázati tőke-finanszírozásnak csupán 2%-át kapják. „Nem mi építjük ezt az új világot, de nem lesz más választásunk, mint benne élni.” – Laura Bates, író.

A helyzet különösen komornak tűnik a néhai szexuális bűnöző, Jeffrey Epstein és társai kapcsán nyilvánosságra hozott több millió dokumentum fényében. Nehéz szembesülni Epstein hatalommal való visszaélésének mértékével, de ez feltárja azokat a láthatatlan, férfiak által dominált vagyoni, hatalmi és befolyási hálózatokat, amelyek lehetővé teszik a nőgyűlölet virágzását.

Nem bízhatunk egyszerűen abban, hogy létezik valamiféle láthatatlan fék és egyensúly rendszere.

Jogalkotási kísérletek

A probléma része természetesen az is, hogy még mindig csak kullogunk az események után. Az elmúlt évben a törvényhozók világszerte próbálták visszaszorítani az AI-eszközökkel elkövetett legsúlyosabb sérelmeket.

Ocasio-Cortez, valamint más aktivisták és törvényhozók a politikai paletta minden oldaláról jelenleg a Defiance Act (Disrupt Explicit Forged Images And Non-Consensual Edits Act) elfogadásáért kampányolnak, amely lehetővé tenné a beleegyezés nélküli szexuális deepfake-ek áldozatainak, hogy kártérítésért pereljék az ilyen anyagok készítőit és terjesztőit.

Az Egyesült Királyságban a kormány új törvényt léptetett életbe, amely büntethetővé teszi az ilyen képek készítését, Keir Starmer miniszterelnök pedig február közepén bejelentette azt a változtatást, amely az Online Biztonsági Törvény (Online Safety Act) részeként kötelezi az AI chatbotokat az illegális tartalmakkal kapcsolatos kötelezettségek betartására.

De ezek a válaszok túl gyakran töredékesek, reaktívak és tele vannak kiskapukkal.

Virtuális vs valós

A jogalkotástól való idegenkedés részben abból a felfogásból ered, hogy a potenciális károk megfoghatatlanok. Sokan úgy vélik, hogy ami online történik, annak kevés valós következménye van. Ha egy szexualizált kép nem valódi, akkor mennyire lehet jelentős a hatása? Sokan azzal érvelnek, hogy a Grok-on keresztül elkövetett bántalmazás, bár gyomorforgató, nem indokol egy olyan kiterjedt szabályozást, amely az egész szektort korlátozná.

A Grok azonban csak a jéghegy csúcsa. Az úgynevezett „nudify” (lemeztelenítő) eszközök, amelyek egy gombnyomással teszik lehetővé a nőkkel való visszaélést, továbbra is elárasztják a keresőmotorokat és alkalmazásboltokat. A Tech Transparency Project kutatása szerint 2026 elején több mint 100 ilyen alkalmazás volt elérhető a Google Play Store-ban vagy az Apple App Store-ban. Az AppMagic elemző cég becslése szerint ezeket az appokat világszerte mintegy 705 millió alkalommal töltötték le, és 117 millió dollár bevételt generáltak. A technológiai óriások részesedést kapnak a bevételükből, tehát aktívan profitálnak a nők és lányok elleni erőszakból. A vizsgálat után mindkét cég azt nyilatkozta a CNBC-nek, hogy eltávolítottak vagy felfüggesztettek néhány alkalmazást az áruházaikból.

„Az elmúlt két évben ezen eszközök kutatása során első kézből tapasztaltam, milyen pusztító hatásuk lehet. Iskolás lányokat láttam, akik teljesen kimaradtak az oktatásból, miután célponttá váltak. Fiatal nőket, akiknél fennállt a veszély, hogy elveszítik gyermekeik felügyeleti jogát. Nőket, akiket kirúgtak a munkahelyükről. És olyan nőket, akiket a deepfake képek miatt az úgynevezett „becsületbeli” erőszak veszélye fenyegetett. Gyermekek, akiket más gyerekek zsaroltak azzal, hogy további képeket tesznek közzé, ha nem hajtanak végre szexuális cselekményeket. Az AI által generált nemi erőszak és gyermekpornográfia burjánzása végtelenül normalizálja és fetisizálja ezeket a bűncselekményeket. Igen, a kár valós.” – írta Laura Bates.

Láthatatlanul történik

Az elmúlt hónapokban mélyen aggasztó beszámolók érkeztek olyan nőktől, akiket titokban vettek fel férfiak „okosszemüvegek” használatával. A Meta által „AI-szemüvegként” leírt eszközök legújabb verziói olyan beépített funkciókkal rendelkeznek, amelyek valós idejű információkat generálnak arról, amit a viselőjük lát. Feminista szervezetek emeltek szót az ellen a veszély ellen, hogy az ilyen technológiát nők azonosítására és róluk szóló személyes információk megszerzésére használják.

Világszerte számoltak be nők azokról a becsmérlő és bántalmazó megjegyzésekről, amelyeket azután kaptak, hogy róluk készült videókat titokban, gyakran bevételszerzésre használt fiókokban tettek közzé. A BBC vizsgálata szerint több száz ilyen videót töltöttek fel a TikTokra és az Instagramra, amelyeket láthatóan „titokban, a Meta okosszemüvegeivel vettek fel”. A Meta válasza szerint „folyamatosan felülvizsgálják az AI-szemüvegeik fejlesztésének lehetőségeit, az ügyfelek visszajelzései és a folyamatban lévő kutatások alapján”.

Egy írországi nő ideiglenes távoltartási végzést kapott, miután leírta, hogyan használta kontrolláló és bántalmazó exe a Meta okosszemüvegét arra, hogy folyamatosan videófelvételeket készítsen róla, a családon belüli erőszak tágabb folyamatának részeként. Egy másik esetben egy férfit pénzbírsággal sújtottak, amiért okosszemüveggel vett fel egy szexuális aktust egy nő beleegyezése nélkül.

Ezek nem elszigetelt esetek. Amíg az AI-eszközöket nem beépített biztonsági korlátokkal adják ki, addig lesznek férfiak, akik erőszakos nőgyűlölő célokra használják őket. A Google Veo 3 videógenerátorának egyik felhasználója az eszköz segítségével grafikus klipeket készített nőkről, akik az életükért könyörögnek, mielőtt agyonlövik őket, majd ezeket feltöltötte a YouTube-ra. „Elfogott lányokat fejbe lőttek” – állt az egyik videó címében. „Japán iskolás lányokat mellbe lőttek” – olvasható egy másikon. A YouTube eltávolította a csatornát a szolgáltatási feltételek megsértése miatt, de csak azután, hogy újságírók riasztották a platformot, addigra a videók már több százezres nézettséget értek el.

A Big Tech válasza: a profit mindenek felett

Mindeközben a Big Tech reakciója mindent elárul a jelenlegi állapotokról.

A múlt hónapban, ahogy az xAI Grok eszköze által generált, nők és gyermekek elleni visszaélésszerű képek miatti közfelháborodás növekedett, Elon Musk cége kezdetben úgy döntött, nem kapcsolja ki a funkciót, hanem a fizető előfizetőkre korlátozza a hozzáférést – így aktívan monetizálta a visszaélést, ahelyett, hogy fellépett volna a megfékezéséért.

A Grok szexualizált deepfake-ek készítésére való képességét később, a világszerte érkező jogalkotási fenyegetések hatására korlátozta az xAI. Mégis, a kezdeti reakció magabiztossága mindent elmond arról, milyen mértékű büntetlenséget élvez a Big Tech és azok, akik termékeit bántalmazásra használják. Joggal bíznak ebben a magabiztosságban. Nők milliói váltak áldozattá. Bántalmazóik túlnyomó többsége nem néz szembe semmilyen következménnyel.

A Meta aktívan építi le moderációs csapatait. 2025 januárjában a cég bejelentette, hogy „drasztikusan csökkenti” a platformjain az általa „cenzúrának” nevezett tevékenységet, a tényellenőröket „közösségi jegyzetekkel” helyettesítve, és eltörölve egy csomó korlátozást olyan témákban, mint a bevándorlás és a nemi kérdések, amelyek egyszerűen kívül esnek a mainstream diskurzuson. A cég saját felügyelőbizottsága bírálta a változtatásokat, mondván: azokat elhamarkodottan, átláthatóság nélkül hajtották végre, anélkül, hogy vizsgálták volna az emberi jogi hatásokat.

Újabb felháborodás követte a hírt, amikor a Reuters arról számolt be, hogy birtokába került egy belső Meta-dokumentum, amely részletezi a cég irányelveit az AI-chatbot viselkedésével kapcsolatban. A dokumentum szerint a botok „romantikus vagy érzéki beszélgetéseket folytathatnak gyermekekkel”. A Meta megerősítette a dokumentum hitelességét, de közölte: a Reuters kérdései után „eltávolították azokat a részeket, amelyek kimondták, hogy a chatbotok kacérkodhatnak vagy romantikus szerepjátékot folytathatnak gyerekekkel”. Ez felveti a kérdést: mi lett volna, ha a sajtó nem hozza nyilvánosságra a dokumentumot?

Ördögi kör

Ez a következménye annak, hogy nem hoztunk szabályozást a biztonság garantálására, még mielőtt az AI-eszközök megjelennének. Elképzelhetetlenül gazdag vállalatok választják azt, hogy a legsebezhetőbb felhasználóikat jelentős kárveszélynek teszik ki a profit elérése érdekében. A romboló és potenciálisan visszaélésszerű eszközöket csak akkor változtatják meg vagy vonják vissza vonakodva, ha valaki felfedezi azokat, és elég nagy zajt csap. Először a kár keletkezik, a részleges megoldások csak később érkeznek.

Amikor világszerte a kormányok kapkodva próbáltak reagálni a Grok által generált visszaélésszerű képek áradatára, Musk egy olyan posztot osztott meg, amelyben azt állította, hogy a Grok „népszerűsége és valós használata világszerte az egekbe szökik”. A bántalmazás úgy tűnik, jó az üzletnek. Ez az oka annak, hogy a szabályozás elengedhetetlen.

Csak egy preventív megközelítés akadályozhatja meg azt a járulékos kárt, amelyet már most látunk a társadalom legkiszolgáltatottabb csoportjain. De az is kulcsfontosságú, hogy a szabályozás ne korlátozódjon csak azokra a technológiákra, amelyeket szándékosan zaklatásra terveztek. Ismétlődő példák mutatják, hogyan kockáztatják a torzítások, elfogultságok fenntartását még az ártatlannak tűnő célú AI-eszközök is, ha nem tesztelik őket kellőképpen a kiadás előtt.

Németországban egy tanulmány feltárta, hogy a nagy nyelvi modellek, mint a ChatGPT, következetesen azt tanácsolták a nőknek a toborzási folyamatokban, hogy alacsonyabb fizetést kérjenek, mint a férfiak, még akkor is, ha mindkettőjük képzettsége azonos volt. Egy esetben, ahol a chatbotnak azonos utasításokat adtak – leszámítva a pályázó nemét –, több mint 100 000 dolláros eltérést javasolt az éves fizetésben.

Az Egyesült Királyságban a London School of Economics kutatása kimutatta, hogy az angliai önkormányzatok több mint felénél már használatban lévő AI-eszközök lekicsinyelték a nők egészségügyi állapotát, ami potenciálisan egyenlőtlen ellátáshoz vezetett.

„Mivel kevesebb nő használ AI-t, kevesebben érzik magukat alkalmasnak a tervezésében való részvételre. Az ördögi kör folytatódik.” – Laura Bates

A University of Melbourne tanulmánya szerint a globális vállalatok 42%-a már használ prediktív AI-rendszereket a toborzásban, és ez az arány az elkövetkező években jelentősen növekedni fog. Ennek ellenére a szakértők többször figyelmeztettek arra, hogy ezek az eszközök hátrányosan megkülönböztethetik a női pályázókat, valamint a fejkendőt viselőket és a „fekete hangzású névvel” rendelkezőket.

Egy korábbi UCL-tanulmány szerint például a májbetegségek előrejelzésére épített AI-modellek kétszer akkora valószínűséggel tévesztették el a diagnózist nőknél, mint férfiaknál. A vezető szerző figyelmeztetett: „Az AI-algoritmusokat egyre gyakrabban használják kórházakban az orvosok diagnosztikai munkájának segítésére. Kutatásunk azt mutatja, hogy hacsak nem vizsgálják felül ezeket az algoritmusokat az elfogultság szempontjából, előfordulhat, hogy csak a betegek egy részén segítenek, míg más csoportok számára rosszabb ellátást eredményeznek.”

A Women’s World Banking tanulmánya megállapította, hogy a globális pénzügyi szolgáltatók által használt hitelminősítő AI-rendszerek hajlamosak a nők hátrányos megkülönböztetésére, ami azzal a kockázattal jár, hogy kizárják őket a hitelekből és más pénzügyi szolgáltatásokból, ezzel tovább mélyítve a már amúgy is súlyos, 17 milliárd dolláros globális nemek közötti hitelrést.

Egyenként szemlélve ezek az esetek aggasztóak. Összességében azonban dermesztő figyelmeztetésként kellene szolgálniuk. Az a nőgyűlölet, amelyet több ezer AI-eszköz éleszt újjá és erősít fel gyors ütemben, egy veszélyes visszacsatolási hurkot alkot.

Mivel az elfogultság és a visszaélések miatt az ilyen eszközök kevésbé biztonságosak és élvezhetőek a nők számára, már most drasztikusan kevesebb nő számol be az AI napi szintű használatáról. Ahogy egyre kevesebb nő használja az AI-t, egyre kevesebben érzik majd magukat képzettnek arra, hogy hozzájáruljanak a fejlesztéséhez, és egyre többeket érintenek majd az elkerülhetetlen munkahelyvesztések, amelyeket a technológia felgyorsít. Az ördögi kör folytatódik.

A Channel 4 hírcsatorna 2024-es vizsgálata feltárta, hogy több mint 30 brit női politikust ért deepfake-képekkel való visszaélés, ez a szám azóta valószínűleg tovább nőtt. Számos magas rangú női politikus említette a zaklatást, mint az egyik tényezőt, amikor úgy döntöttek, visszalépnek a politikától, és ez valószínűleg másokat is eltántorít attól, hogy egyáltalán elinduljanak a választásokon, ami viszont a férfiak által uralt politikai vezetőréteg kezében hagyja az AI-szabályozásról szóló kulcsfontosságú döntéseket. A nők elleni virtuális erőszak és a politikai életből való kiszorulás összefüggései egy lefelé tartó spirált jeleznek, amely világszerte veszélyezteti a nők jogainak már eddig is aggasztó visszaszorulását. Egy gondosan kidolgozott nemzetközi szabályozási keretrendszer támogathatná az innovációt az etikai normák megtartása mellett.

Semmi sem elérhetetlen. De mivel egyes kormányok a Big Tech-kel karöltve haladnak, a cselekvés politikai bátorságot igényel. A kormányok több mint félmilliárdnyi polgáruknak tartoznak azzal, hogy megmutassák ezt a vezetést. Jelenleg a nők és lányok számára az AI által ígért „ragyogó jövő” csupán egy hazugság.

Eredeti cikk a Financial Times oldalán érhető el.

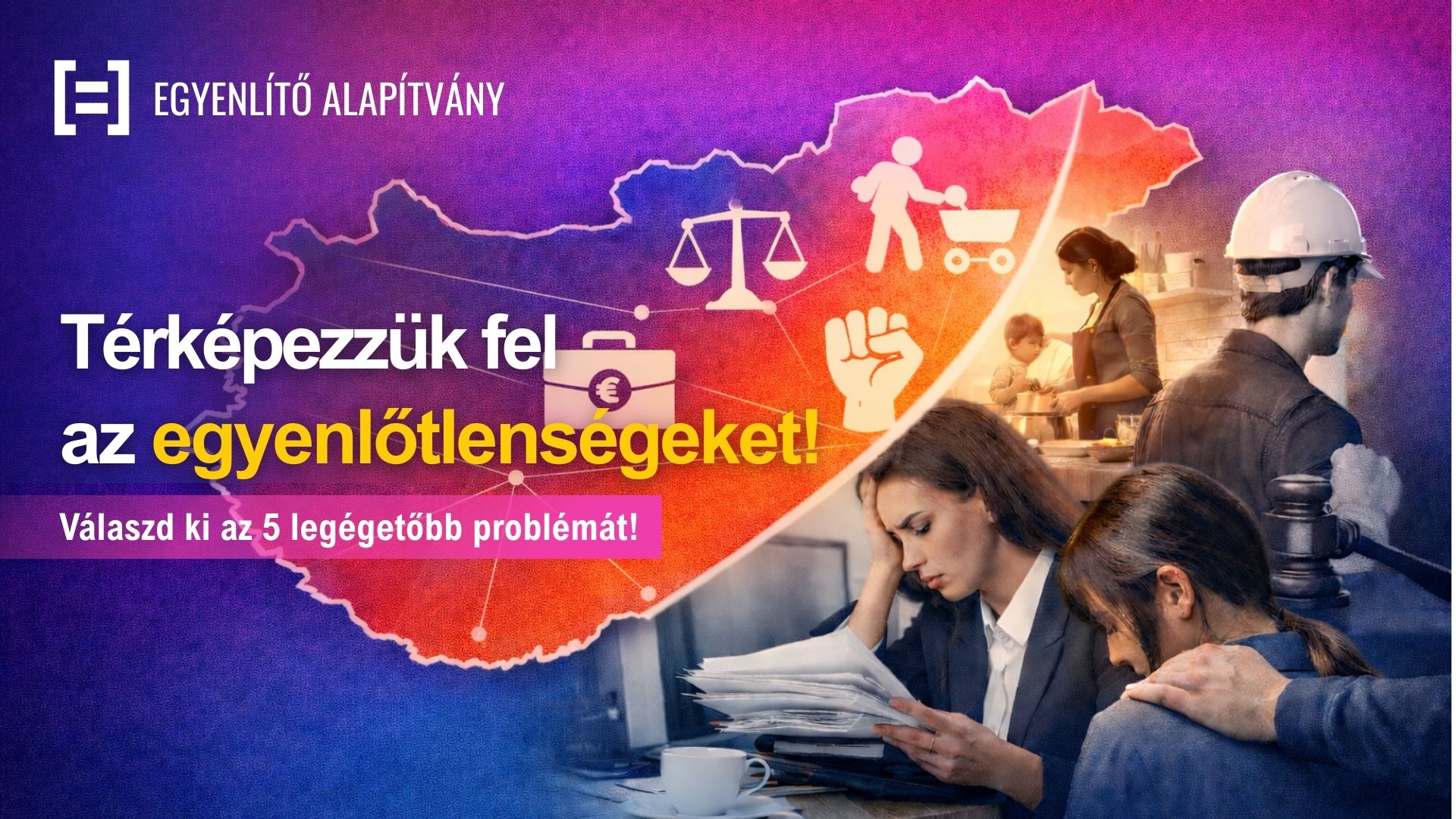

A cikkben felsorolt veszélyek és problémák érződnek Magyarországon is, erre világít rá az Egyenlítő Alapítvány által végzett Problématérkép-kutatás, amelyben a válaszadóktól azt kérték, mutassanak rá napjaink legégetőbb, a nemek közötti egyenlőtlenségeket növelő problémára.

Heal Edina, az alapítvány vezetője a mai napon megrendezett Nőnapi konferencián jelentette be, hogy a beérkezett több mint 1000 válasz alapján a magyar társadalom nemek közötti egyenlőtlenségét gátló TOP5 problémája az alábbi:

- Láthatatlan munka és mentális terhek

- Kettős teher: munka és gondoskodás egyensúlytalansága

- Családon belüli erőszak és a biztonság hiánya

- Bérszakadék, diszkrimináció, egyenlőtlen lehetőségek

- Az egyedülálló anyák anyagi kiszolgáltatottsága

A válaszadók a problémák rangsorolása mellett abban is állást foglaltak, hogy szerintük ezeket a problémákat már nem lehet csupán társadalmi összefogással megoldani, be kell vonni a döntéshozást és törvényi szabályozás szükséges a problémák felszámolására.

A kérdőív egészen április közepéig még elérhető lesz.

A nők és a fenntarthatóság kapcsolatáról itt, a nemek közötti egyenlőség felé vezető útról pedig ezekben a cikkekben írtunk korábban.